W przełomowym badaniu naukowcy wykorzystują model sztucznej inteligencji podobny do ChatGPT do pasywnego dekodowania ludzkich myśli z niespotykaną dokładnością, co otwiera nowe możliwości w obrazowaniu mózgu i budzi obawy o prywatność.

Zespół naukowców dokonał odkrycia, stosując model sztucznej inteligencji GPT (Generative Pre-trained Transformer) podobny do ChatGPT do rekonstrukcji ludzkich myśli z dokładnością do 82% na podstawie nagrań funkcjonalnego rezonansu magnetycznego (fMRI). Ten bezprecedensowy poziom dokładności w dekodowaniu ludzkich myśli z nieinwazyjnych sygnałów otwiera drogę do niezliczonych możliwości naukowych i potencjalnych przyszłych zastosowań, twierdzą naukowcy.

Badanie i metodologia

Wyniki badań zostały opublikowane w Nature Neuroscience. Naukowcy z University of Texas at Austin wykorzystali fMRI do zebrania 16 godzin nagrań fal mózgowych od trzech osób, które słuchały określonych opowieści. Zespół przeanalizował te nagrania, aby zidentyfikować konkretne bodźce neuronalne, które odpowiadały poszczególnym słowom.

Dekodowanie słów z zapisów MRI od dawna stanowiło wyzwanie ze względu na wysoką rozdzielczość przestrzenną fMRI, ale niską ich rozdzielczość czasową. Chociaż obrazy fMRI są wysokiej jakości, pojedyncza myśl może utrzymywać się w sygnałach mózgu do 10 sekund, co powoduje, że nagrania rejestrują jednocześnie połączone sygnały około 20 angielskich słów wypowiadanych w typowym tempie.

Przed pojawieniem się dużych modeli językowych GPT (Large Language Models – LLM), zadanie to było dla naukowców niemal nie do pokonania. Techniki MRI mogły zidentyfikować tylko kilka konkretnych słów, o których myślał człowiek. Jednak dzięki zastosowaniu specjalnie wyszkolonego GPT LLM, naukowcom udało się stworzyć potężne narzędzie do ciągłego dekodowania ludzkich myśli..

Model GPT z niezwykłą dokładnością generował zrozumiałe sekwencje słów z postrzeganej mowy, mowy wyobrażonej, a nawet z niemych filmów:

- Mowa postrzegana (badani słuchali nagrania): 72-82% dokładności dekodowania.

- Mowa wyobrażona (badani opowiadali sobie mentalnie jednominutową historię): 41-74% dokładności.

- Filmy nieme (badani oglądali pozbawione dźwięku fragmenty filmów Pixara): 21-45% dokładności w dekodowaniu interpretacji filmu przez osobę badaną.

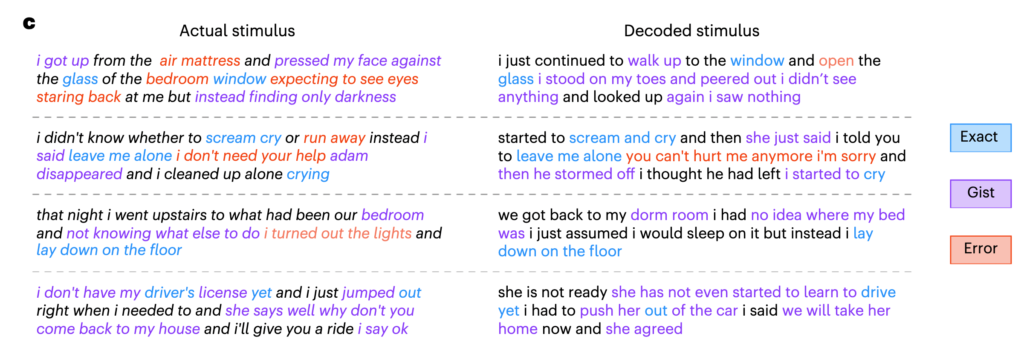

Model AI potrafił rozszyfrować zarówno znaczenie bodźców, jak i konkretne słowa, o których myślały osoby badane, począwszy od zwrotów takich jak „połóż się na podłodze”, poprzez „zostaw mnie w spokoju”, aż po „krzycz i płacz”.

,Rzeczywiste myśli vs. myśli rozszyfrowane.Należy zwrócić uwagę na zdumiewającą dokładność, z jaką dekoder GPT LLM był w stanie odczytać poszczególne frazy i ogólne znaczenie.

Obawy dotyczące prywatności związane z dekodowaniem myśli

Perspektywa dekodowania ludzkich myśli rodzi pytania o prywatność psychiczną. Wychodząc naprzeciw tym obawom, zespół badawczy przeprowadził dodatkowe badanie, w którym dekodery wyszkolone na danych od innych osób zostały użyte do dekodowania myśli nowych osób.

Badacze stwierdzili, że „dekodery wytrenowane na danych pochodzących od innych osób osiągały wyniki ledwie powyżej poziomu prawdopodobieństwa”, podkreślając znaczenie korzystania z własnych zapisów mózgowych osób badanych dla dokładnego szkolenia modeli AI. Co więcej, osoby badane były w stanie oprzeć się wysiłkom dekodowania, stosując takie techniki jak liczenie do siedmiu, wymienianie zwierząt gospodarskich lub opowiadanie zupełnie innej historii, co znacznie zmniejszyło dokładność dekodowania.